Tekoäly otteli ihmistä vastaan: Monimutkainen ongelma piti ratkaista 600 minuutin aikana – Tässä voittaja

Uutiset ja blogit

Uutiset ja blogit

Työelämä

Uutinen

TES-neuvottelut nostavat palkkoja sadoilla miljoonilla euroilla

Lakkokevät toi korkeasti koulutetuille pitkälti samat palkankorotukset kuin muillekin. Tekkiläinen saa lisää palkkaa tuhansia euroja vuosina 2025–2027.

Työelämä

Uutinen

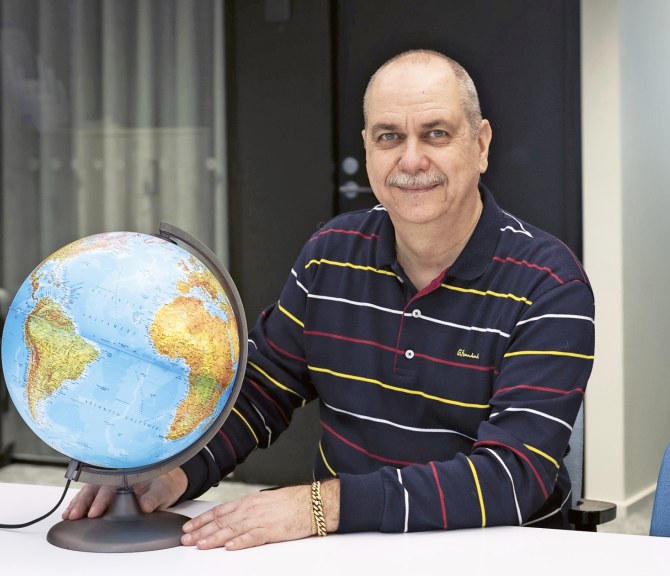

Frisbeegolf on ongelmanratkaisua käytännössä

Yliopistonlehtori Ville Nivalainen hurahti frisbeegolfiin, perusti Suomen neljänneksi suurimman lajiseuran ja alkoi myydä valmistamiaan kiekkoja auton takakontista. Luonnontieteilijän taustasta on lajissa etua.

Järjestö

Uutinen

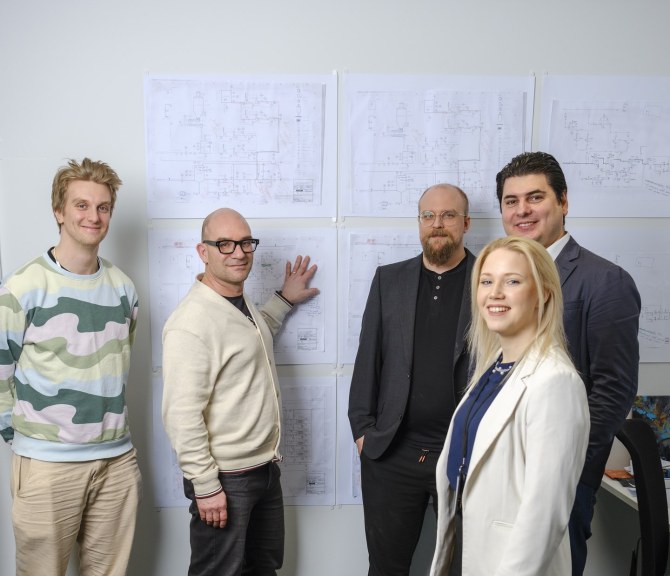

TEKin valiot

TEKissä toimii tällä hetkellä kymmenen valiokuntaa, joiden roolina on auttaa TEKin hallitusta. Tässä jutussa esittelemme ne kaikki.

Uutiset ja blogit

Järjestö

|

Blogimerkintä

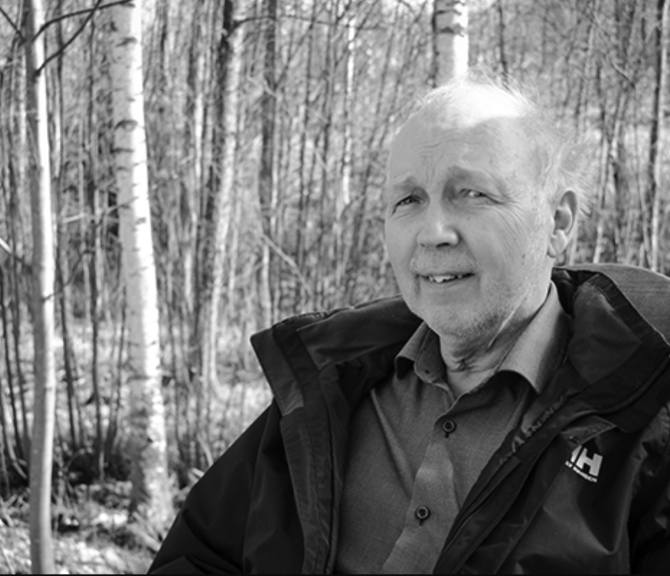

Kiitos, kiitos ja kiitos

Vaikka lähden TEKin johdosta, TEK ei lähde minusta.